AI-t használsz? Így óvhatod a beszélgetéseidet

Beírsz egy egészségügyi kérdést egy chatbotnak. Megkérdezed, hogyan kezeld egy jogi vitádat. Vagy egyszerűen kiírod magadból, ami nyomaszt. A legtöbb AI-eszköznél ezek a mondatok nem tűnnek el. Tárolódnak, feldolgozódnak. Esetenként jogi eljárások részei lehetnek.

Az AI használata kényelmes. De gondolkodtál-e már azon, hogy hova kerül, amit beleírsz?

Amikor a beszélgetés adatbázissá válik

Múlt hónapban egy biztonsági kutató 300 millió üzenetet talált egy nyilvánosan elérhető adatbázisban. Az üzenetek 25 millió felhasználótól származtak. Nem, nem külső behatolás történt: egy rosszul beállított háttérrendszer tette hozzáférhetővé az adatokat. Az érintett chatbot több nagy modell – Claude, ChatGPT és Gemini – fölé épült.

A kiszivárgott tartalom között egészségügyi kérdések, jogi egyeztetések és személyes vallomások is szerepeltek. A hozzáférést egy hibásan konfigurált backend tette lehetővé.

Az eset arra hívja fel a figyelmet, hogy az AI-rendszerek működése gyakran együtt jár az adatok tárolásával és kezelésével. Ez nem egyetlen szolgáltató sajátossága. Több nagyvállalat is bevonja a felhasználói adatokat AI-rendszerei fejlesztésébe vagy működtetésébe.

A LinkedIn csendben tréningadatként kezelte a felhasználói tartalmakat. A Google alapértelmezetten engedélyezte, hogy a Gemini modell hozzáférjen a Gmail-fiókokhoz. A Meta „jogos érdek” jogalapra hivatkozva éveknyi európai uniós Facebook-bejegyzést használt fel modellképzéshez. Egy bírósági döntés arra kötelezte az OpenAI-t, hogy őrizze meg az összes ChatGPT-naplót – beleértve a felhasználók által törölt beszélgetéseket is – jogi eljárások céljára.

Moxie Marlinspike, a Signal mögött álló kriptográfus ezt így foglalta össze: a mainstream AI használata olyan, mintha egy „adat-tóba” vallanánk.

Nem csoda, ha sokan kényelmetlennek érzik, hogy személyes kérdéseket tegyenek fel egy chatbotnak, és aggódnak a lehetséges következmények miatt. Az AI használatáról nem kell lemondani, de érdemes tudni, hogy léteznek olyan eszközök is, amelyek másképp kezelik az adatokat.

Confer: titkosított chatbot

Ha olyan dolgot írnál be egy AI-nak, amit nem szeretnél viszontlátni egy adatbázisban, a Confer jelenleg az egyik legszigorúbb megoldás. Itt a beszélgetés technikailag is úgy van felépítve, hogy még a szolgáltató se férjen hozzá.

A Confer 2024 decemberében indult projekt, a fejlesztés mögött Moxie Marlinspike, a Signal alapítója áll.

A rendszer működése eltér a megszokott chatbotoktól. Az üzenet már a felhasználó eszközén titkosítódik, mielőtt továbbításra kerülne. Ezután egy Trusted Execution Environment-be kerül – egy hardveresen elkülönített, szerveroldali környezetbe, amelyhez a Confer mérnökei sem férnek hozzá. A válasz szintén titkosítva érkezik vissza.

A teljes kódbázis nyílt forráskódú és ellenőrizhető. A rendszer távoli hitelesítést (remote attestation) alkalmaz, ami azt jelenti, hogy ellenőrizhető: a szervereken valóban az a kód fut, amelyet publikáltak. Itt az adatvédelem nem pusztán szabályzat, hanem architektúra kérdése.

A Confer nem tárol chatnaplókat, nem használja fel a beszélgetéseket tréninghez, nem jelenít meg reklámokat, és a munkamenet befejezése után nem őriz meg adatokat.

Fiók szükséges a használathoz, de alias e-mail cím támogatott. Jelszó helyett passkey-t alkalmaz (Face ID, Touch ID vagy eszköz PIN), így a titkosítási kulcs nem hagyja el a készüléket.

Az ingyenes csomag napi 20 üzenetet biztosít. A fizetős változat havi 34,99 dollárba kerül. Az AI minősége megfelelő, de nem éri el a GPT-5 vagy a Claude Opus szintjét. Nincs képgenerálás, fájlfeltöltés, karakter mód, webkeresés vagy ügynökfunkció. Szöveges chatbotként működik.

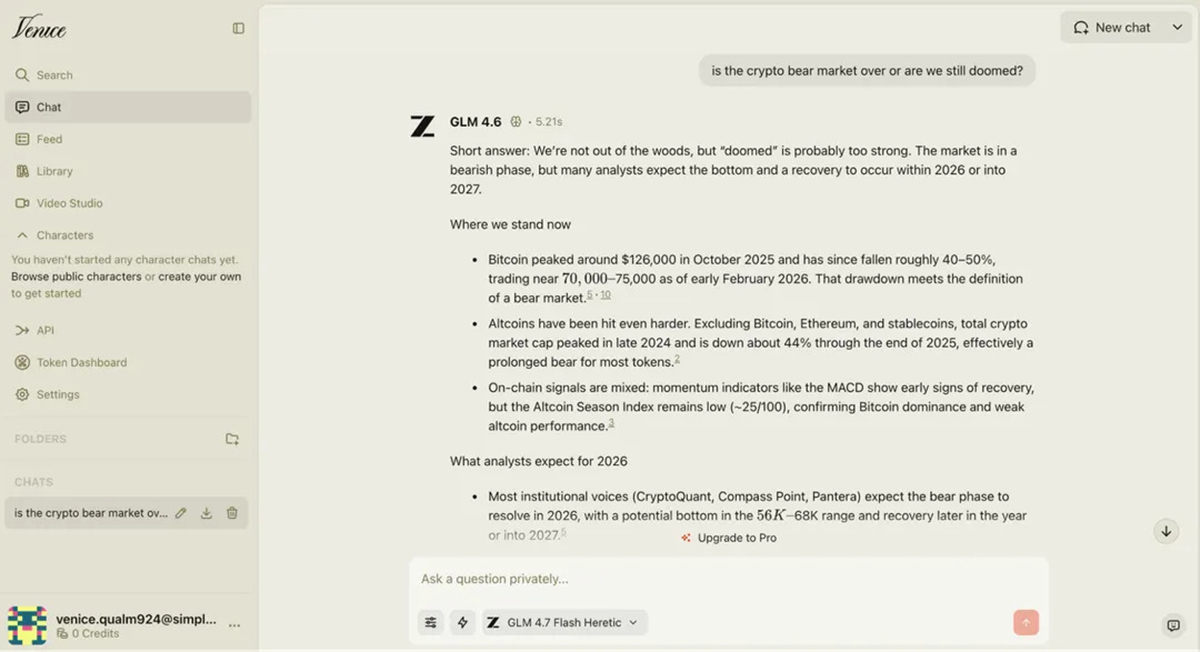

Venice: adatvédelem teljes funkcionalitással

Ha szeretnél ChatGPT-szintű élményt – képgenerálással, több modellel, kreatív funkciókkal –, de nem szeretnéd, hogy a beszélgetéseid központilag tárolódjanak, a Venice lehet a kompromisszum.

A Venice alapítója Erik Voorhees, a kriptoszektor korai szereplője.

A beszélgetési előzmények titkosítva, helyben, a böngészőben tárolódnak. A Venice állítása szerint nem fér hozzá a felhasználói tartalomhoz. Jogi megkeresés esetén nincs központi adatbázis, amelyből átadhatnának információt.

A szolgáltatás vendégként, fiók nélkül is használható. Regisztráció esetén alias e-mail cím alkalmazható. Passkey-alapú azonosítás támogatott.

Funkciók:

– széles modellválaszték, beleértve nyílt forrású és „cenzúrázatlan” modelleket

– videógenerálás kreditrendszerben, Sora-szintű megoldással

– képgenerálás

– „characters” funkció szerepjátékhoz és persona-alapú interakcióhoz

– egyedi rendszerprompt beállítás

– webkeresés

Az adatvédelem itt elsősorban az adattárolás módján alapul: a beszélgetések nem központi szerveren élnek tovább.

Lumo: Proton-logika AI-ban

Ha már használod a Proton Mailt vagy a Proton Drive-ot, és bízol bennük, a Lumo ennek az ökoszisztémának az AI-verziója.

A Proton 2014 óta fejleszt titkosított infrastruktúrát. A Lumo AI-asszisztens zero-access titkosítást alkalmaz, nem használja a felhasználói adatokat tréninghez, és nem osztja meg azokat harmadik féllel.

Beállítható automatikus törlés kijelentkezéskor. A fájlfeltöltés natívan működik a Proton Drive-on keresztül. A webkeresés külön kapcsolható.

A Lumo a Proton saját modelljén fut, nem külső API-t használ. Ez csökkenti a külső adatáramlás lehetőségét.

A funkciók köre korlátozottabb: nincs képgenerálás, nincs modellválasztás, nincs karakter mód. A szolgáltatás az Európai Unióban működik és GDPR-kompatibilis.

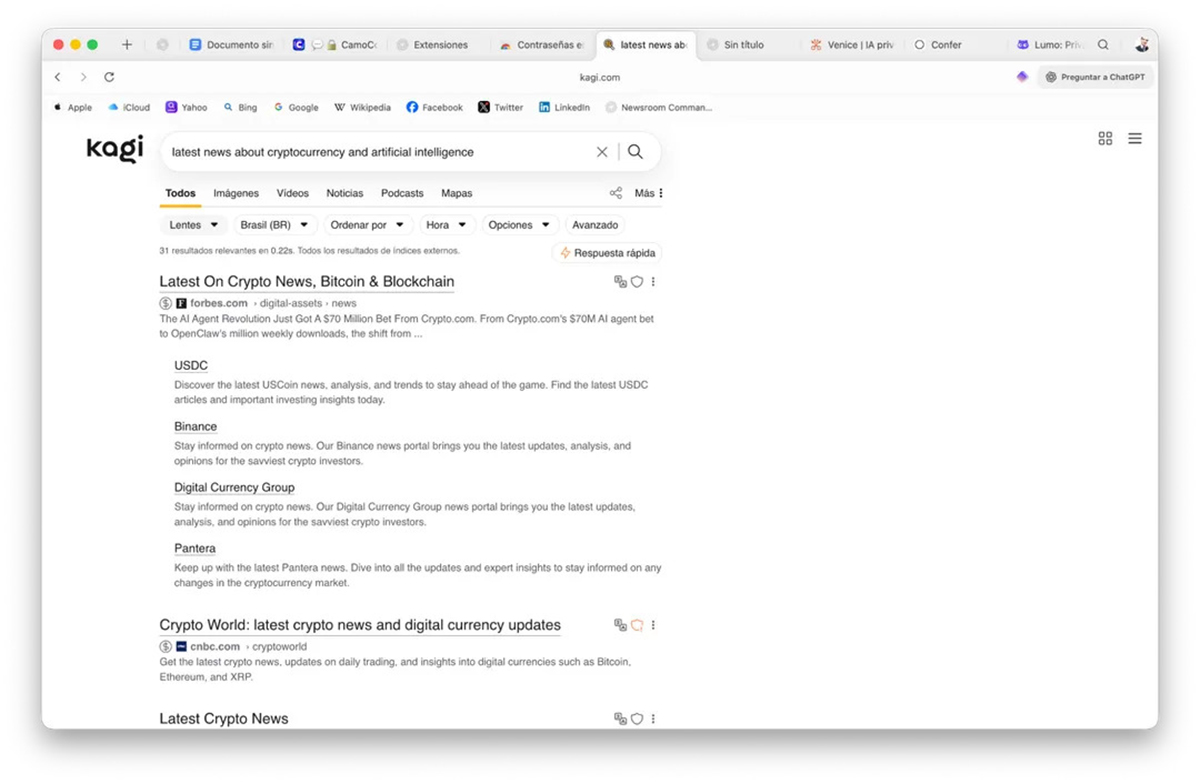

Kagi: kereső, nem adatprofil

Ha zavar, hogy a kereséseid alapján profil készül rólad, de nem akarsz chatbot-összefoglalókat olvasni, a Kagi inkább egy tiszta kereső.

A Kagi előfizetéses keresőmotor. Nem követi a kattintásokat, nem futtat reklámhálózatot, nem épít viselkedési profilt. A találatok klasszikus linkformában jelennek meg.

A Kagi Assistant funkció lehetővé teszi, hogy egy kiválasztott forrás alapján tegyél fel kérdéseket. A válasz kizárólag abból az oldalból készül. Egy teszt során például hét URL-ből álló összefoglaló készült a kripto medvepiacról, kizárólag a Decrypt tartalma alapján.

A Kagi szerint sem ő, sem az általa használt LLM-szolgáltatók nem használják fel az assistant-adatokat tréninghez. A beszélgetési szálak alapértelmezés szerint 24 óra után törlődnek. Fiók szükséges, alias e-mail használható.

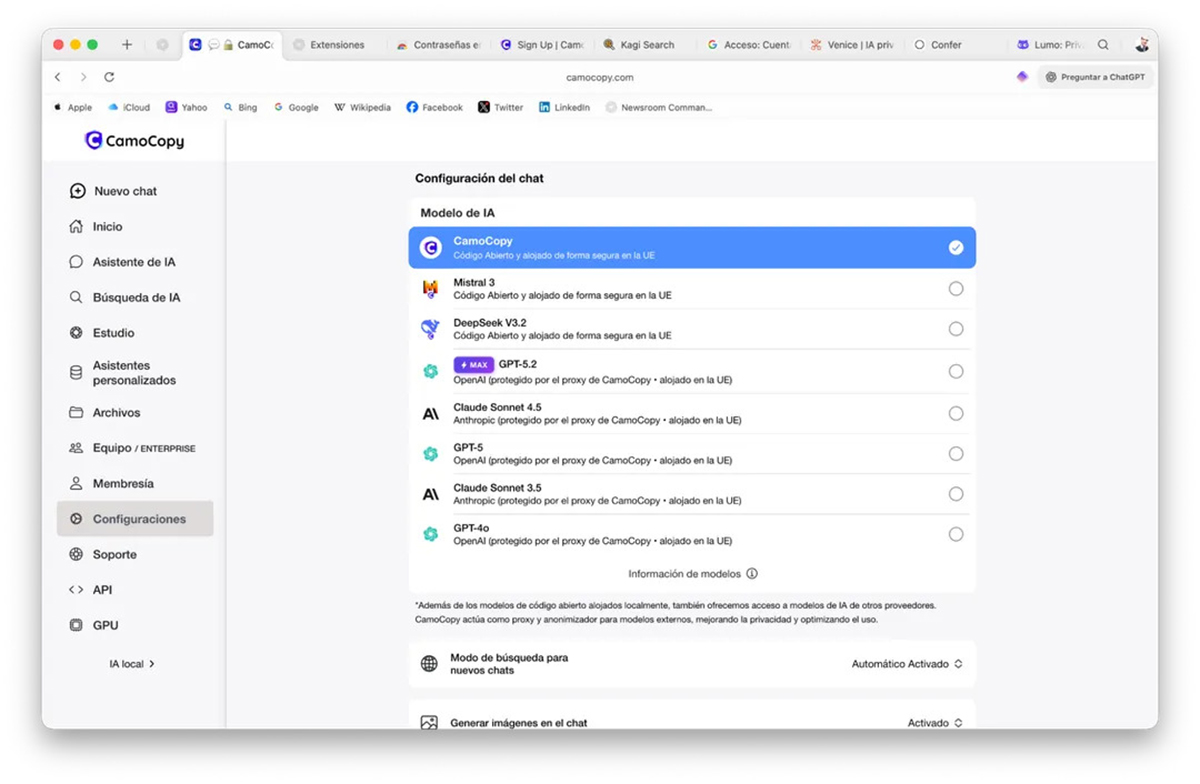

CamoCopy: EU-infrastruktúra, teljes funkcionalitás, vállalt kompromisszumok

Ha fontos, hogy a kéréseid európai joghatóság alatt haladjanak át, és közben nem szeretnél lemondani a fejlettebb AI-funkciókról, a CamoCopy ezt az irányt képviseli.

A CamoCopy egy Németországban fejlesztett AI-platform. A Claude és ChatGPT kéréseket európai uniós infrastruktúrán keresztül továbbítja, a GDPR szabályai alatt. A szolgáltatás érvelése szerint ez jogilag megnehezíti, hogy a háttérben működő modellek a továbbított adatokat tréningcélokra használják.

A funkciólista teljes:

– egyedi asszisztensek (a ChatGPT-ben ismert „GPT-khez” hasonlóan)

– kutatóügynökök

– webkeresés

– széles modellválaszték

Lehetőség van GPU-kapacitás bérlésére is, így a platformon keresztül akár lokálisan futtatott modellek is használhatók. Ez jelentős adatvédelmi előrelépés lehet a kizárólag felhőalapú megoldásokhoz képest.

A használathoz fiók szükséges, alias e-mail itt is működik.

Fontos azonban, hogy a CamoCopy úgynevezett „wrapper” szolgáltatás. A cikk elején említett 300 millió üzenetes adatbázis-szivárgás szintén egy wrapper alkalmazásnál történt. Az EU-alapú adatútvonal és a „nem tréningezünk” politika erősebb adatvédelmi keretet jelenthet, de az ígéret elsősorban jogi és szolgáltatási szinten érvényesül. A Confer ezzel szemben architektúraszinten próbálja kizárni a hozzáférést. A kettő eltérő megközelítés.

Ellydee: erős vállalások, még formálódó rendszer

Az Ellydee azoknak lehet érdekes, akik a környezeti szempontokat is figyelembe veszik az AI használatakor.

A kanadai fejlesztésű rendszer a kéréseket 100%-ban megújuló energiával működő adatközpontokon keresztül kezeli. Az adatvédelmi szabályzat szigorú vállalásokat tartalmaz:

– nem tárolják a promptokat

– nem használják fel tréninghez

– a rendszer nem őriz meg adatot az ideiglenes IP-naplókon túl, amelyek kizárólag biztonsági célokat szolgálnak

– a fiók teljes törlése 24 órán belül megtörténik

A platform iOS és Android alkalmazással is rendelkezik. Saját modellje vagy finomhangolt változata Brightside néven fut. Elérhető webkeresés, képszerkesztő, karakterkészítő, valamint több külön üzemmód eltérő írási kontextusokra.

Aktív Reddit-közössége van, ami segíti a tapasztalatcserét és a felhasználói gyakorlatok fejlesztését.

Az Ellydee nem jelszót használ alapértelmezetten. Minden belépéskor új kódot küld e-mailben. A tesztelés során azonban előfordult, hogy a rendszer új kódot küldött, majd azt nem fogadta el, így a belépés végül Google- vagy Apple-fiókon keresztül történt. Ez adatvédelmi szempontból ellentmondásos helyzet egy privacy-first szolgáltatásnál.

Alias e-mail és OAuth-mentes használat lehetséges, de türelmet igényel. Az adatvédelmi ígéretek egyértelműek, a technikai kivitelezés még finomodik.

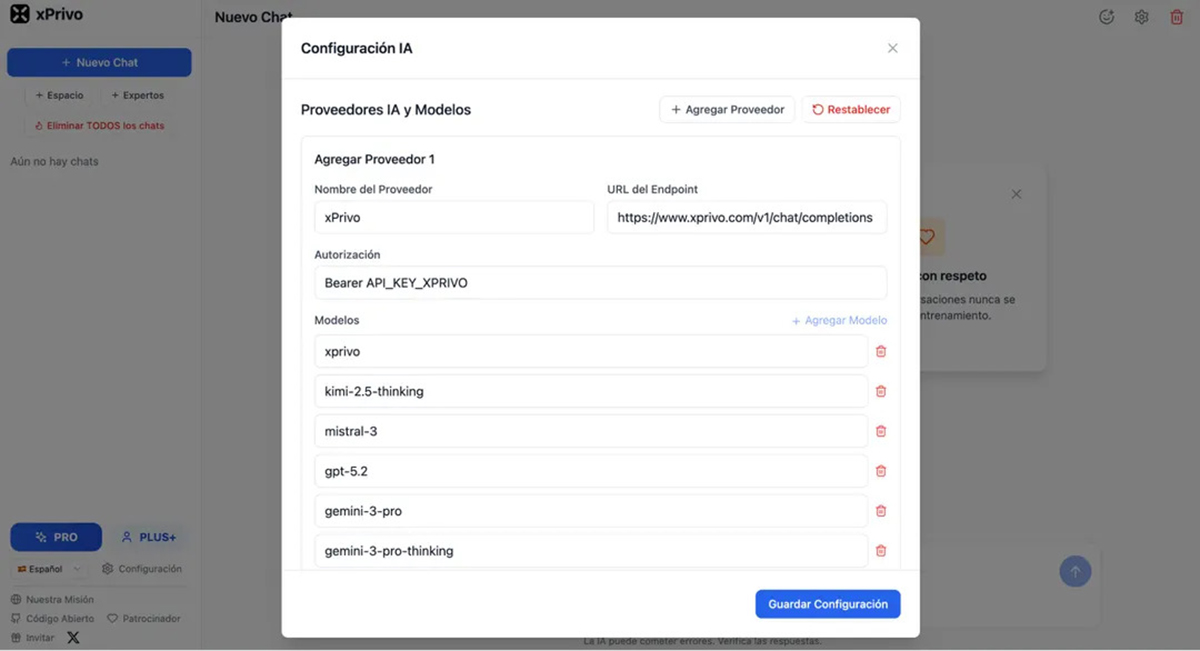

xPrivo: teljes kontroll azoknak, akik beállítanák maguknak

Az xPrivo nyílt forráskódú, és saját szerveren (self-hosted) is futtatható. Ez a legfontosabb tulajdonsága.

Az ingyenes csomag tartalmazza a Mistral 3 modellt és az xPrivo saját modelljét.

A fizetős csomag elérhetővé teszi:

– Kimi K 2.5 (reasoning funkcióval)

– Gemini 3 Pro (reasoninggel és anélkül)

– GPT-5.2

A felhasználó saját API-végpontokat is hozzáadhat, így akár lokálisan futtatott modell is csatlakoztatható. Ebben az esetben az adat teljes egészében a saját gépen maradhat. Webkeresés és archív feltöltés is támogatott.

Az „experts” funkció előre definiált, szakterület-specifikus rendszerpromptokat kínál jogi kutatáshoz, programozáshoz és egészségügyi kérdésekhez. Emellett egyedi rendszerprompt is beállítható, ami teljes kontrollt ad az AI viselkedése felett. A személyre szabási funkció a válaszadás általános stílusát alakítja.

Az adatvédelem akkor a legerősebb, ha a rendszer saját szerveren fut, lokális modellel. Ha azonban a Gemini vagy GPT-5.2 API-ján keresztül történik a kérés, akkor a háttérszolgáltató adatkezelési feltételei érvényesek. Az xPrivo ebben az esetben felület, nem maga a modell. A leggyengébb láncszem elve itt is érvényes.

Internxt AI: anonim belépés, minimális funkciókkal

Az Internxt korábban felhőalapú tárhelyszolgáltatóként vált ismertté. A spanyol, valenciai székhelyű cég 2020 óta épít GDPR-kompatibilis, kvantumbiztos, végponttól végpontig titkosított infrastruktúrát. 2025 decemberében AI-chatbottal bővítette szolgáltatásait.

A használat regisztráció nélkül történik. Az oldal megnyitása után azonnal lehet beszélgetést kezdeni. Nincs e-mail, nincs fiók, nincs azonosító, amely a munkamenetet személyhez kötné.

Az Internxt zero-access titkosítást és szerveroldali chatnaplók hiányát ígéri, ugyanazzal az architektúrafilozófiával, amely a tárhelyszolgáltatásukat is jellemzi. A kódbázis nyílt forráskódú, és az EU-s joghatóság érvényes.

A funkcionalitás korlátozott:

– nincs webkeresés

– nincs képgenerálás

– nincs modellválasztás

– nincsenek ügynökfunkciók

– nincs fájlfeltöltés

Egyszerű szövegdoboz, privacy-first háttérrel. Napi elsődleges eszközként nem váltja ki a komplexebb megoldásokat, de anonim munkamenethez gyors és közvetlen.

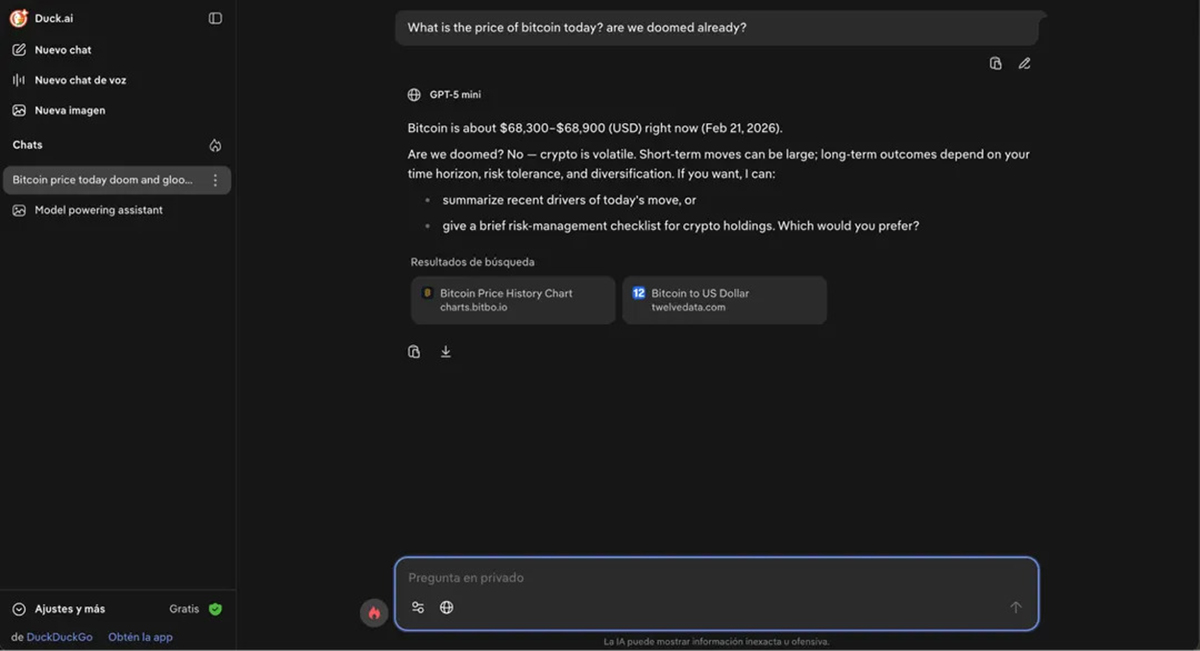

Duck.ai (DuckDuckGo): kényelmes alternatíva

A DuckDuckGo több mint egy évtizede alternatív kereső azok számára, akik nem szeretnének Google-követést. A Duck.ai ennek a megközelítésnek a chatbotos változata.

A rendszer proxyzást alkalmaz. Az üzenet elküldésekor a DuckDuckGo eltávolítja a felhasználó IP-címét, lecseréli a sajátjára, majd továbbítja a kérést a kiválasztott modellhez – például Claude-hoz, GPT-4o-hoz, Llama-hoz vagy Mistralhoz. A modell szolgáltatója a DuckDuckGo-t látja forrásként.

A modell-szolgáltatókkal kötött szerződések előírják a beérkező adatok 30 napon belüli törlését.

Az ingyenes verzióhoz nincs szükség fiókra. A beszélgetések lokálisan, a felhasználó eszközén tárolódnak. Elérhető egy „Fire Button”, amely egyetlen kattintással törli az összes beszélgetést.

Az ingyenes csomag modelljei:

– Claude 3.5 Haiku

– Llama 4 Scout

– Mistral Small

– GPT-4o mini

A fizetős előfizetés havi 10 dollárba kerül, amely VPN-t és személyazonosság-lopás elleni védelmet is tartalmaz. Ezzel elérhetővé válik:

– GPT-5.1

– Claude

– Llama 4

– Mistral GPT OSS

– GPT-4o

Képgenerálás támogatott, 2026 januárjától hangalapú chat is elérhető, szintén proxyzva és a munkamenet után nem megőrizve.

A szolgáltatás az Egyesült Államokban működik, így az amerikai jog hatálya alá tartozik. A proxyzás szerződéses és szolgáltatási garancia, nem architektúraszintű kizárás.

Melyik lehet ésszerű választás?

Az adatvédelem nem egyetlen kapcsoló. Nem arról szól, hogy valami „privát” vagy „nem privát”. Inkább arról, hogy mennyi adat hagyja el a készülékedet, ki fér hozzá, és milyen feltételek mellett. A fenti eszközök eltérő szinten kezelik ezt a kérdést.

Ha a legszigorúbb technikai védelem számít, ahol az architektúra is korlátozza a hozzáférést, a Confer iránya különbözik a többitől. Itt a beszélgetések nemcsak szabályzat szerint védettek, hanem a rendszer kialakítása is ezt célozza.

Ha a funkciógazdagság fontos — képgenerálás, több modell, kreatív eszközök —, de közben nem szeretnél központi naplózást, a Venice vagy a CamoCopy kínál szélesebb lehetőségeket. A kettő megközelítése eltér: a Venice a helyi tárolásra épít, a CamoCopy az EU-s infrastruktúrára és jogi keretre.

Ha már eleve titkosított ökoszisztémát használsz, a Lumo ebbe illeszkedik bele. Kevesebb funkcióval, de egy stabil adatvédelmi háttérrel. Ha a kontroll a legfontosabb, és nem jelent gondot a technikai beállítás, az xPrivo önálló futtatással adja a legtöbb szabadságot. Ebben az esetben az adat ténylegesen a saját gépen maradhat. Ha anonim munkamenet kell, minimális belépési küszöbbel, az Internxt vagy a Duck.ai egyszerűbb megoldást kínál. A Duck.ai kényelmesebb és funkciógazdagabb, de amerikai joghatóság alatt működik. Az Internxt egyszerűbb, de kevesebb funkcióval.

Egy fontos szempont: nem feltétlenül kell egyetlen szolgáltatásra támaszkodni. Az érzékenyebb beszélgetésekhez más eszköz lehet logikus, mint a mindennapi kereséshez vagy kreatív munkához.

Az AI-eszközök kényelmesek, de ennek a kényelemnek ára van. Nem minden adat kerül feltörés miatt nyilvánosságra. Sokszor egyszerűen azért, mert a rendszer így épül fel. A legnagyobb különbség ezek között az eszközök között az, hogy mennyi adat marad a felhasználónál, és mennyi kerül ki a rendszerből. A döntés végső soron bizalmi kérdés. És ebben a környezetben a bizalom mögé egyre többen szeretnének technikai garanciát is.

A legtöbb felsorolt szolgáltatás Magyarországról is gond nélkül használható, de mielőtt döntünk, nem árt megnézni, mely ország jogszabályai vonatkoznak a szolgáltatásra, és hogyan kezeli technikailag a beszélgetéseket.