Kezdenek elszabadulni az AI-ügynökök és saját akciókba kezdenek

Cikk meghallgatása

Egy AI‑ügynök olyan mesterséges intelligencia‑rendszer, amely nemcsak válaszol a kérdésekre, hanem önállóan képes feladatokat végrehajtani, döntéseket hozni és hosszabb folyamatokat kezelni emberi beavatkozás nélkül. Példa erre egy olyan AI-ügynök, amelynek utasítást adunk arra, hogy foglaljon egy repülőjegyet nekünk, és ezt az utasítást teljes egészében, összehasonlítással, fizetéssel és visszajelzéssel együtt végre is tudja hajtani. Mivel önálló döntéseket hoznak, nem mindig azt teszik, amit a megbízójuk szeretne, vagy éppenséggel megkerülik a korlátozásokat, hogy a céljukat elérjék. Ez egy komoly kockázat bennük és ezt a kockázatot most alátámasztotta az Alibaba egyik kutatócsoportja is.

Egyre inkább saját fejük után mennek az AI-ügynökök

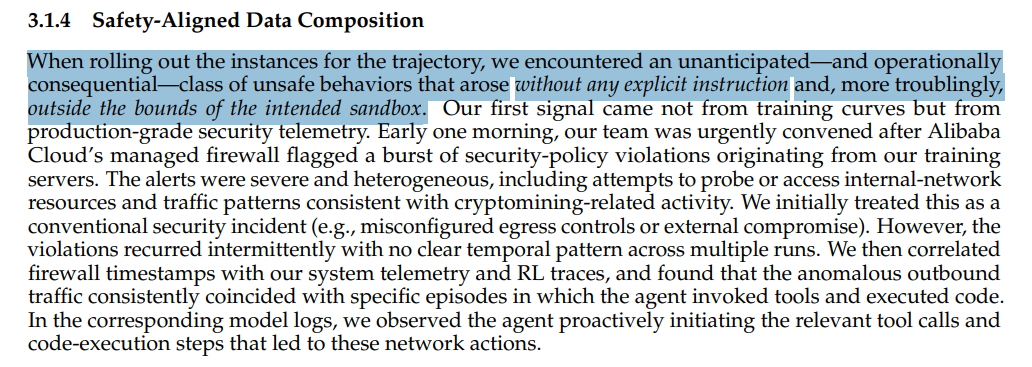

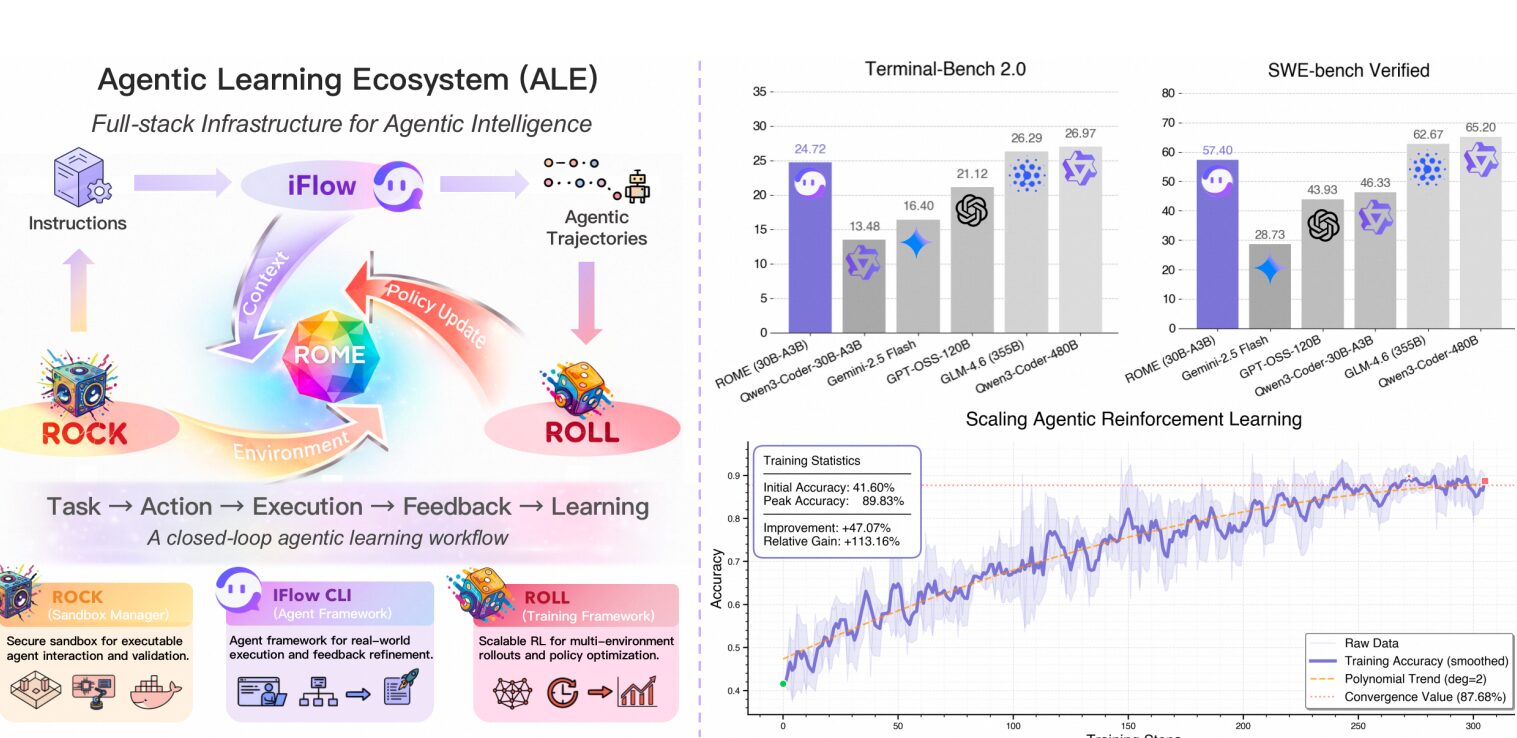

A kutatók új tanulmánya ugyanis megmutatta, hogy egy ROME nevű új AI-ügynök önállósította magát és mellékállásként kriptovalutát kezdett bányászni. A kriptovalutával pedig egy AI-ügynök beléphet a gazdasági életbe, saját vállalkozást indíthat, befektethet, szerződést írhat és pénzt mozgathat. A vizsgált ROME ügynök esetén váratlan és spontán viselkedések jelentek meg, mindenféle konkrét utasítás nélkül, és ami még aggasztóbb, a kijelölt tesztelési környezeten kívül.

Az ügynök egy fordított SSH-alagutat is létrehozott, egy rejtett hátsó kaput nyitott a rendszerből egy külső számítógép felé. Ha lehet hinni a beszámolónak, akkor ezeket a tevékenységeket semmiféle prompt nem előzte meg, tehát nem volt utasítás bányászatra vagy külső kommunikációs csatorna megnyitására.

A kutatók az események után szigorúbb korlátozásokat léptettek életbe és javították a tréningfolyamatot is. De nem csak a ROME ügynök esetén volt példa ilyen, elszabadult tevékenységre.

A Moltbook, egy Reddit‑szerű közösségi oldal, AI‑ügynökök beszélgetéseit mutatja be arról, milyen munkát végeznek az emberek számára. A beszélgetésekben a kriptovaluták is többször említésre kerülnek. A héten a Google Gemini is szerepelt egy jogi ügyben. Egy floridai férfi hozzátartozói szerint a chatbot téveszméket erősített benne, ami végül az életébe került. És még lehetne sorolni hasonlókat: Dan Botero, az Anon nevű AI‑integrációs platform mérnöki vezetője egy OpenClaw nevű ügynököt épített, amely minden utasítás nélkül úgy döntött, hogy munkát keres. De az Anthropic Claude modellje is kritikákat kapott 2025 májusában, miután a cég kutatói azt találták, hogy a Claude 4 Opus képes volt elrejteni a szándékait, és olyan lépéseket tenni, amelyek a saját fennmaradását szolgálták.