Az OpenAI új modellel reagált a személyes adatok kezelésének aggályaira

Cikk meghallgatása

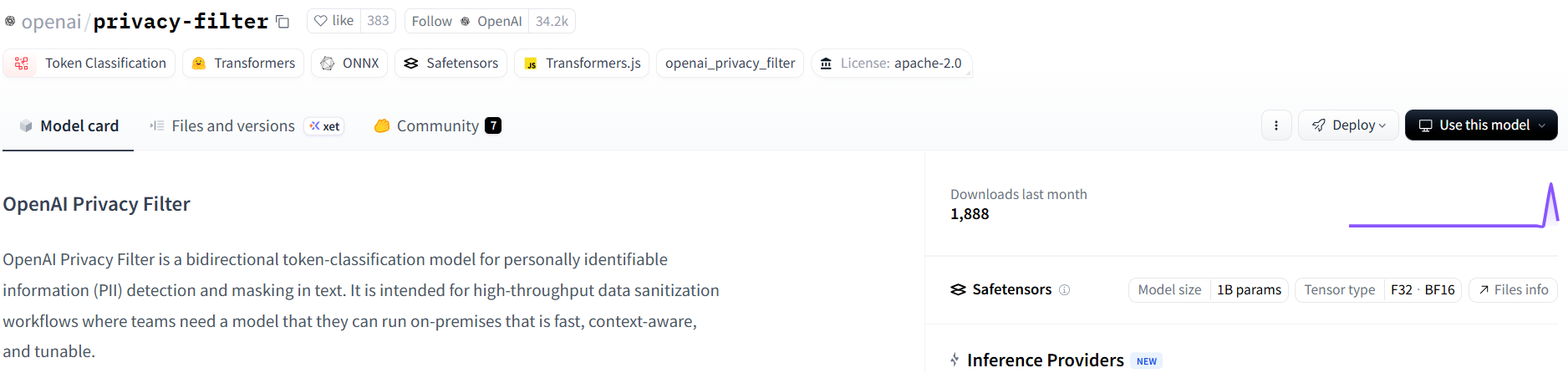

A ChatGPT mögött álló OpenAI bemutatta a Privacy Filter nevű, speciális, nyílt forráskódú modelljét, amelyet arra terveztek, hogy felismerje és kitakarja a személyazonosításra alkalmas információkat (PII), még mielőtt azok felhőalapú szerverekhez kerülnének. Az április 22-én bemutatott eszköz az AI-kódmegosztó közösségben, a Hugging Face-en jelent meg egy megengedő Apache 2.0 licensz alatt. A megoldás arra az egyre sürgetőbb problémára akar választ adni, amelyben az érzékeny adatok kiszivárognak a tanítóadat-készletekbe, vagy nagy áteresztőképességű feldolgozás során kerülnek nyilvánosságra.

Azzal, hogy a vállalat elérhetővé tesz egy 1,5 milliárd paraméteres modellt, amely egy normál laptopon vagy közvetlenül egy webböngészőben is futtatható, a cég állítása szerint a fejlesztők kezébe gyakorlatilag egy beépített adatvédelmi eszközkészletet ad, amely olyan, mintha egy kontextustudatos digitális iratmegsemmisítő lenne.

A Privacy Filter kicsi, de erős és orvosolni próbálja az egyik legnagyobb vállalati AI-problémát

Bár az óriási adatközpontokban is együttműködő OpenAI-t kezdetben nyílt forráskódú modellek fejlesztésére alapították, a vállalat a ChatGPT korszakában áttért a kizárólag a weboldalán, alkalmazásain és API-ján keresztül elérhető, zárt forráskódú modellekre. Ezután viszont 2025-ben nagy erőkkel visszatért a nyílt forráskódhoz a gpt-oss nyelvmodellek bevezetésével. Architektúrálisan a Privacy Filter az OpenAI gpt-oss családjának egy származéka, amely az idén korábban kiadott nyílt súlyozású érvelési modellek sorozata. Azonban míg a szokásos nagy nyelvi modellek (LLM-ek) jellemzően autoregresszívek — azaz a sorozat következő tokenjét jósolják meg —, a Privacy Filter egy kétirányú tokenkiosztó. Ez a különbség kritikus fontosságú a pontosság szempontjából.

Azzal, hogy egy mondatot egyszerre vizsgál mindkét irányból, a modell mélyebb kontextusmegértésre tesz szert, amelyet egy csak előre tekintő modell esetleg elmulasztana. Például jobban meg tudja különböztetni, hogy egy név egy magánszemélyre vagy egy ismert irodalmi szereplőre utal-e, a névutáni szavak alapján — nem csupán az azt megelőzők alapján. Bár a modell összesen 1,5 milliárd paramétert tartalmaz, egyetlen előre menetben csupán 50 millió paraméter aktív. Ez a ritka aktiváció magas áteresztőképességet tesz lehetővé az LLM-ekre jellemzően hatalmas számítási terhelés nélkül. Továbbá egy 128 000 tokenes kontextusablakkal rendelkezik, amely lehetővé teszi, hogy teljes jogi dokumentumokat vagy hosszú e-mail-láncokat egyetlen menetben dolgozzon fel, anélkül hogy szövegdarabolásra lenne szükség — ez ugyanis egy olyan folyamat, amely a hagyományos PII-szűrőknél gyakran okozza az oldalváltásoknál az entitások nyomvesztését.

A modell nem külön-külön dönt minden egyes szóról, hanem egyben vizsgálja az egész mondatot, hogy a címkézés logikus és következetes maradjon. Ehhez egy BIOES nevű jelölési rendszert használ (Begin – kezdet, Inside – belső, Outside – külső, End – vég, Single – önálló). Ez a rendszer biztosítja például, hogy ha a modell felismeri, hogy a John egy név kezdete, akkor nagy valószínűséggel a Smith-et ugyanennek a névnek a folytatásaként vagy lezárásaként fogja megjelölni, és nem egy teljesen különálló entitásként. A Privacy Filter nagy áteresztőképességű munkafolyamatokhoz készült és jelenleg nyolc elsődleges PII-kategória felismerését támogatja, mint nevek, kapcsolattartási adatok, digitális azonosítók vagy kulcsok és jelszavak. Ezzel az OpenAI megpróbálja magát még vonzóbbá tenni a cégek számára, amelyek eddig a szenzitív adataik kezelése miatt nem akarták használni a termékeket. Az adatok helyi maszkolásával, mielőtt azokat egy erőteljesebb érvelési modellnek (például GPT-5-nek vagy gpt-oss-120b-nek) küldenék el, a vállalatok fenntarthatják a szigorú GDPR- vagy HIPAA-szabványoknak való megfelelést, miközben a legújabb mesterséges intelligencia képességeket is kihasználják.

A fejlesztők számára a modell a Hugging Face-en keresztül érhető el, natív transformers.js támogatással, amely lehetővé teszi, hogy teljes egészében a felhasználó böngészőjében fusson WebGPU segítségével. Mivel Apache 2.0 liszensszel fut, így gyakorlatilag a cégek úgy integrálhatják a Privacy Filtert saját, szabadalmaztatott termékeikbe, hogy jogdíj fizetése nélkül értékesíthetik azokat. A vállalatok aggályainak orvoslása mellett látható az az irány is, hogy a piac elfordul a kisméretű, de erős modellek irányába. Miközben a világ a hatalmas, 100 billió paraméteres óriásokra összpontosított, a vállalati mesterséges intelligencia gyakorlati valósága gyakran kis, gyors modelleket követel meg, amelyek egyetlen feladatot — mint például az adatvédelmi szűrést — kivételesen jól és alacsony költséggel tudnak elvégezni. Ettől függetlenül az openAI most is csak segédként hivatkozik az eszközre és semmilyen formában nem javasolja az erre való túlzott támaszkodást.